【分享本文原因】最近帶領IMV團隊時,我反覆看到一個現象:很多人興沖沖想導入AI,寫了一堆複雜指令,AI卻像天兵瘋狂出包,搞到大家都在幫AI救火,傻眼。

其實,問題不在AI聰不聰明,而是沒搞懂「Harness Engineering」。這篇內容是幫AI初學者破除迷思,看懂為什麼讓AI穩穩做事的關鍵,是一套管控系統,而不是神奇咒語。

-內容目錄-

為什麼想靠AI解決問題,最後卻變成自己瘋狂幫AI救火?

很多初學者剛接觸AI時,都會遇到一個超級痛的卡點。

一開始覺得AI很神,結果把長一點的任務交給AI,AI就開始胡說八道,甚至跑到一半直接歪掉。

大家通常的直覺,都是認為提示詞(Prompt)寫得不夠好,或是餵給大模型的資料不夠多。

於是大家瘋狂上網學怎麼寫神級咒語,結果上線後還是被雷到,根本不敢把重要任務交給AI處理。

這其實不是工具的問題,而是底層理解出了問題。

真正決定大模型能不能在商業場景穩定落地的,不再是模型有多聰明。

而是開發者有沒有為大模型建構一套「Harness Engineering」(外部防護網與管控系統)。

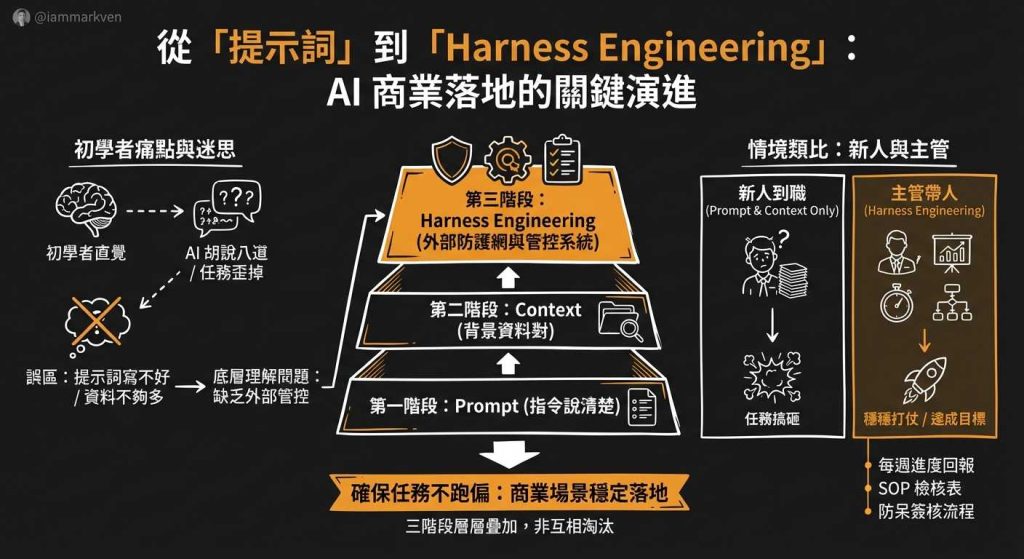

別再只練提示詞!大模型落地的三個必經階段

很多人以為只要把話講清楚,大模型就能無所不能。

但其實 AI 的應用演進,必須經歷三個階段:

第一是 Prompt,把指令說清楚;第二是 Context,把背景資料給對。

第三個階段,才是 Harness Engineering,也就是建立一套確保任務不跑偏的工作環境。

這三個階段不是互相淘汰,而是層層疊加的包容關係。

只靠提示詞,大家只能讓大模型回答單一問題。

要把大模型放到真實商業世界做事,就需要防呆、糾偏與流程管理的機制。

我在IMV內部內訓時,最常用「新人到職與主管帶人」的情境來破題。

Prompt 就像是發給新人的職務說明書,告訴新人要做什麼。

Context 就像是把公司歷年專案檔案跟背景知識,全部塞給新人。

如果你只給指令跟資料,新人一定會搞砸!

因為新人還缺了最重要的管控環節,也就是主管必須建立的「每週進度回報、SOP檢核表、與防呆簽核流程」。

有了這些外部防護網,新人才能穩穩幫公司打仗,這就是 Harness Engineering 的精髓。

真正讓AI失控的,是缺乏「漸進式揭露」與「狀態邊界」

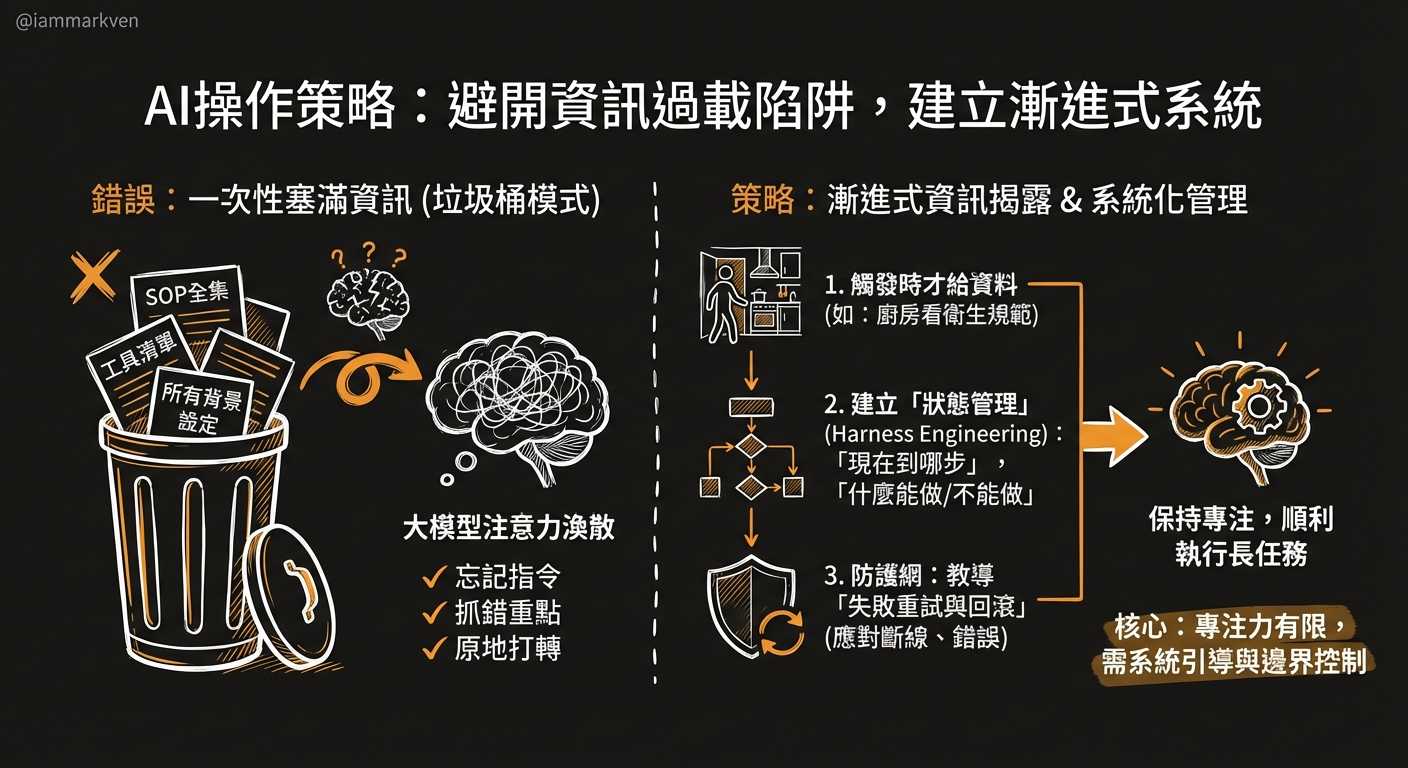

很多初學者在操作AI時,習慣把所有的SOP、工具清單、背景設定一次性全部貼進視窗裡。

大家以為把上下文窗口當作垃圾桶一次塞滿,大模型就會變得超級強大。

結果往往看破手腳,資料餵得越多,大模型反而越容易忘記指令。

甚至大模型會開始抓錯重點,這就是在原地打轉。

真正卡住的問題,是缺乏了「漸進式資訊揭露」的設計。

大模型的注意力是非常有限的,一次給太多資訊,大模型就會注意力渙散。

這就像連鎖店長巡店一樣,主管不會要求店長一進門就背誦整本營運手冊。

高段的系統,是讓店長走到廚房,才看廚房的衛生規範;走到收銀台,才看結帳SOP。

對於AI也是一樣,需要用到的工具與資料,觸發時才給,大模型才能保持專注力。

大模型會失憶,別讓系統像無頭蒼蠅一樣亂撞

另外,大模型本質上是沒有記憶的。

在連續執行的長鏈路任務裡,大模型不會像人類一樣自然記住過去十分鐘做了什麼。

如果你沒有透過 Harness Engineering 幫大模型建立「狀態管理與邊界」,任務隨時會卡死。

開發者必須隨時透過系統告訴大模型:「現在走到哪一步了」、「什麼能做、什麼絕對不能做」。

這才是長任務能順利跑完的關鍵。

還有一個最容易撞牆的地方,很多人把例外當成特例。

但在真實世界裡,API 斷線、網頁改版、工具調用錯誤,這都是常態!

好的防護網系統,必須要教大模型「失敗的時候怎麼重試與回滾」。

而不是遇到錯誤,大模型就直接當機罷工,這才是上線該有的抗壓戰力。

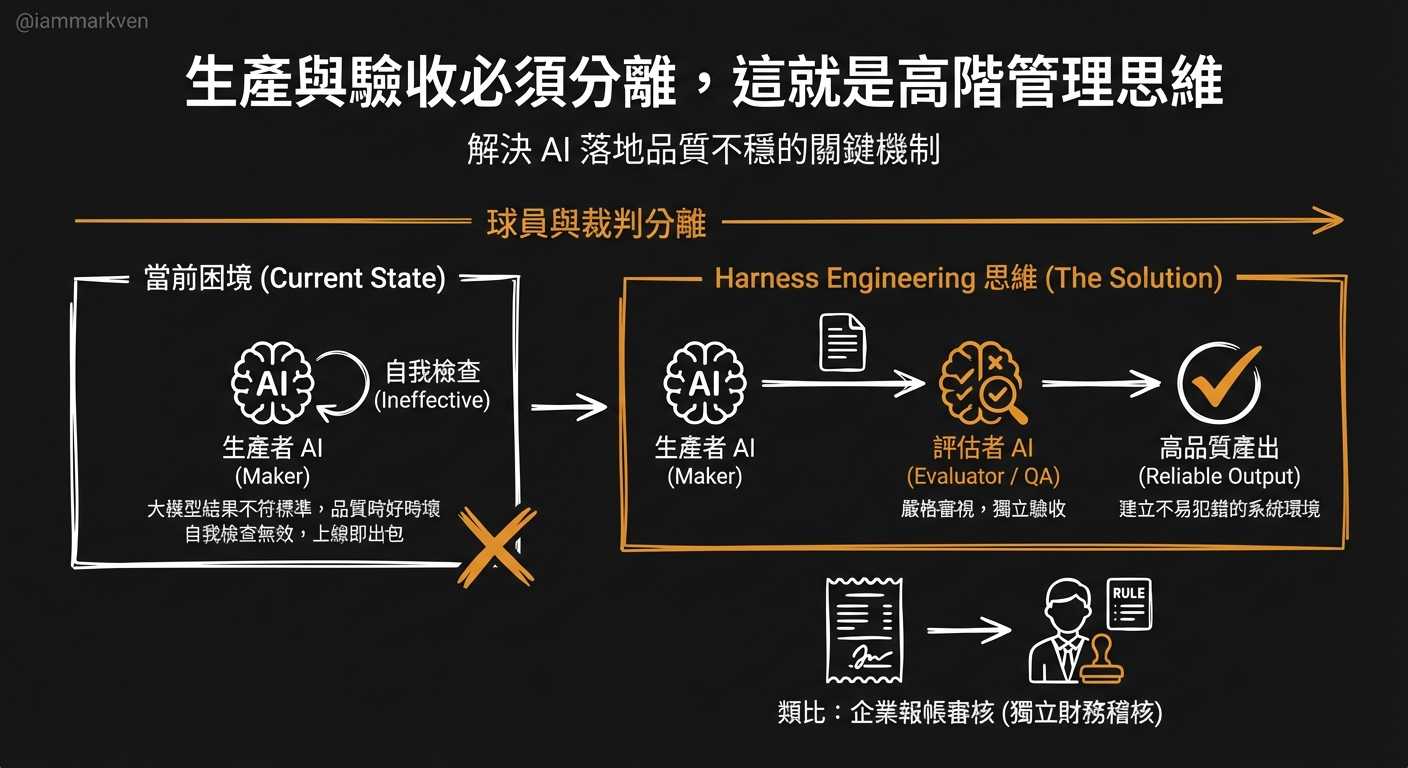

一直救火的主管,永遠帶不出能打仗的AI團隊

我在跟很多企業主聊 AI 落地時,最常聽到大家抱怨:

大模型生成的結果不符合上線標準,品質時好時壞,根本不敢對外發布。

大家通常的做法,就是在同一個指令框裡加上一句:「做完之後請自行檢查有沒有錯誤」。

我直接戳破,這通常是完全無效的碎碎念!

因為你讓寫作業的大模型自己改考卷,大模型一定會過度樂觀,跟你說一切完美。

真正卡住的問題,是系統中缺乏了「球員與裁判分離」的機制。

沒有真實的糾錯循環,上線就是等著出包。

生產與驗收必須分離,這就是高階管理思維

頂尖產品團隊能維持超高成功率的秘密,在於建立獨立的驗收機制(Maker vs. Evaluator)。

這就像是企業內部的報帳審核流程,道理一模一樣。

你絕對不可能讓填寫報帳單的員工,自己批准款項發放吧?

公司一定會有一個獨立的財務稽核角色,來對照收據與法規。

在 Harness Engineering 的思維裡,我們就要建立一個獨立的評估者 AI。

讓這個獨立角色像 QA 一樣,嚴格審視生產者 AI 的產出。

這樣才能建立起真正不易犯錯的系統環境。

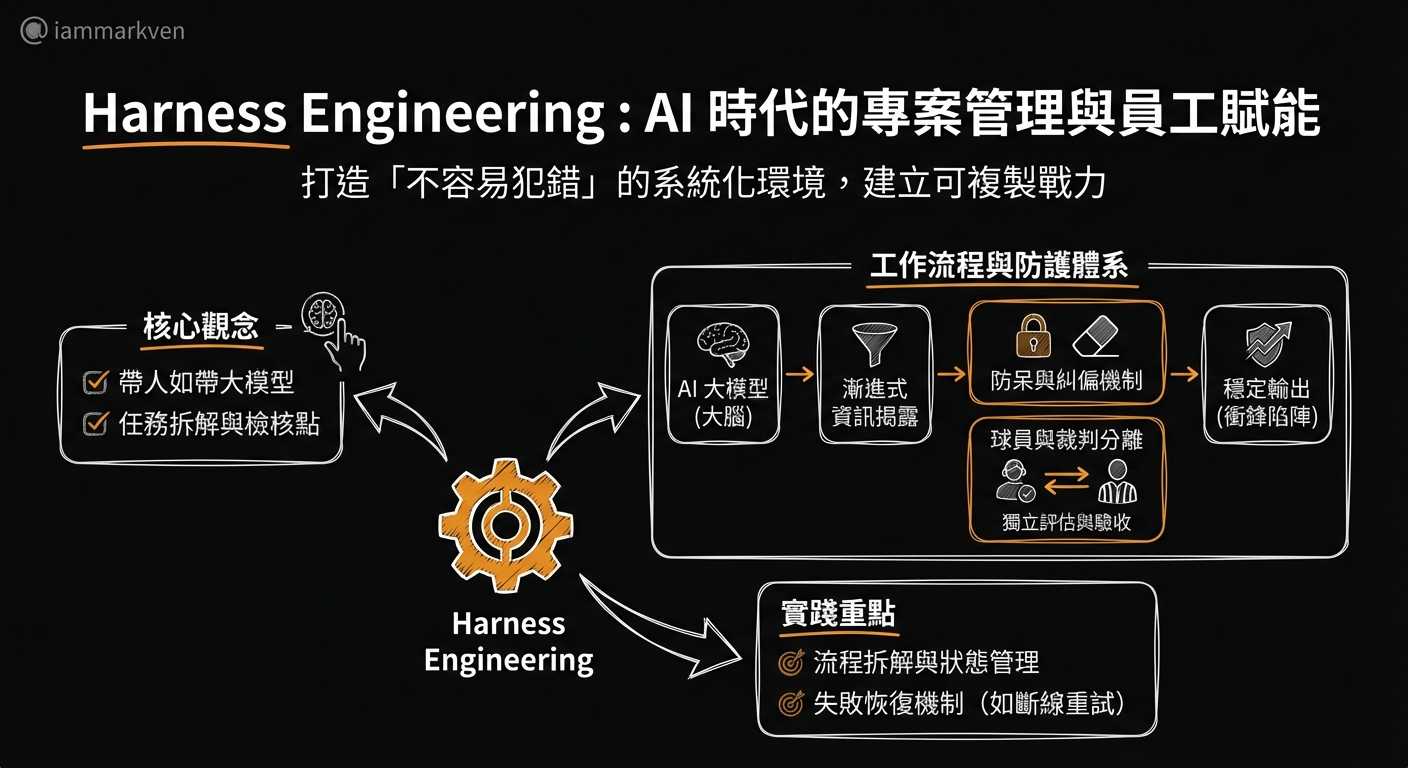

團隊天花板在主管,搞懂 Harness Engineering 才是 AI 時代的基本功

這幾年看下來,很多急著把 AI 導入工作的人,最後都撞牆了。

因為大家一直逼著模型變聰明,卻忽略了底層防護環境的建構,這就是知道跟做到的巨大差距。

Harness Engineering 聽起來是個很硬的工程名詞,但底層邏輯非常單純。

Harness 的本質,其實就是「AI 時代的專案管理與員工賦能」。

你怎麼帶人,就應該怎麼帶大模型。

與其期待一個超級天才員工永遠不出錯,不如打造一個讓員工「不容易犯錯」的系統化環境。

這才是長期累積下來的可複製戰力。

如果你現在還是個想要學 AI 的初學者,千萬不要只停留在寫咒語的階段。

把這套 Harness Engineering 觀念融入工作流程,把任務拆解、建立檢核點、把生產與驗收分開。

當你把這些基本功練好,大模型就會對你死心塌地,穩穩幫你衝鋒陷陣!

Q1. 什麼是 Harness Engineering?

簡單來說,如果 AI 大模型是聰明的大腦,那 Harness Engineering 就是一套包含「防呆、糾偏與流程管理」的外部工作環境,確保 AI 代理在執行長任務時不會跑偏。

Q2. 為什麼給大模型很多背景資料,大模型反而會忘記重點?

因為大模型的注意力是有限的。開發者把上下文窗口當作垃圾桶一次塞滿,大模型就會注意力渙散。正確做法是「漸進式資訊揭露」,也就是需要用到的工具與資料,觸發時才給大模型。

Q3. 為什麼大模型生成的品質總是時好時壞?

因為開發者通常讓執行任務的大模型自己檢查自己,這通常會導致評估過度樂觀。要解決這個問題,必須建立「球員與裁判分離」的機制,引入獨立的評估者 AI 來驗收。

Q4. 如果我不懂程式碼,能應用 Harness Engineering 的思維嗎?

絕對可以!初學者不需要會寫 code,初學者只需要懂得「拆解流程」與「任務狀態管理」。把 SOP 拆成一個個小檢查點,透過現成的自動化工具或平台去引導大模型,這就是 Harness 的實踐。

Q5. 大模型遇到 API 斷線就罷工怎麼辦?

這就是 Harness Engineering 必須處理的「失敗恢復機制」。在真實世界裡,報錯是常態,開發者必須在系統設計時教大模型遇到例外情況該如何重試或回滾,而不是直接當機死在那裡。